Elle surveille les liens locaux et étendus, les serveurs, les applications et les bases de données. La plateforme de monitoring alerte en cas de pépin, consigne chaque changement et aide à reconfigurer les équipements du datacenter.

Au fil des ans, l’entreprise acquiert des commutateurs et des serveurs de divers fabricants. La supervision globale de son infrastructure la contraint à suivre des systèmes hétérogènes, des applications et des environnements distribués, à corriger ici un paramètre ou à relancer ailleurs un service défectueux.

Des alertes délivrées en temps réel

Paessler France,

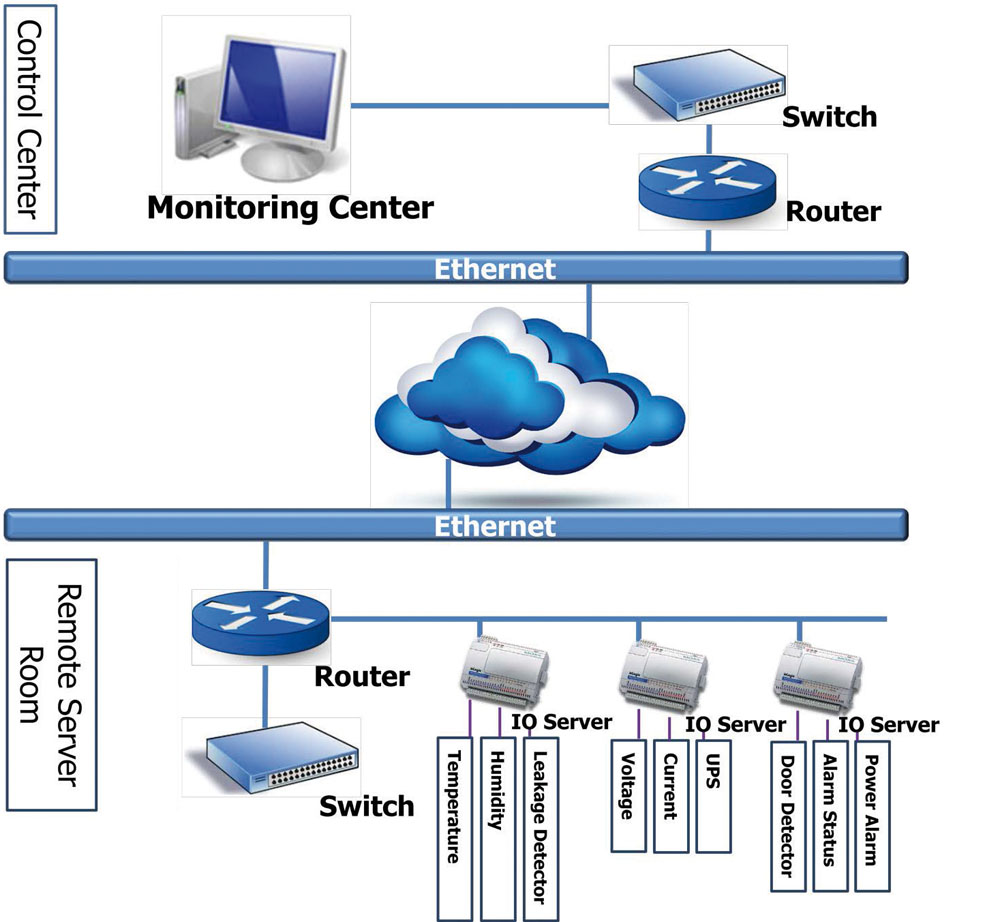

« La solution pour tout voir sous une même interface consiste à adopter un langage commun. En l’occurrence, ce sont les protocoles tels SNMP, NetFlow et WDMI qui permettent aux plateformes de supervision de recueillir, puis de digérer les informations de chaque environnement. Ensuite, on crée des paliers de notification pour être averti, par exemple lorsqu’une ferme de serveurs voit son volume dépasser les 90% de sa capacité de stockage », explique Christophe Da Fonseca, responsable développement de Paessler France, éditeur de la plateforme PRTG. Ce type d’alerte permet de planifier une opération de maintenance, d’ajouter des disques durs au cluster, sans perturber les utilisateurs, le soir ou le week-end par exemple. On évite ainsi le crash des applications s’appuyant sur la ferme de serveurs en question. L’administration des ressources via une plateforme de supervision suit une gestion pro-active de l’infrastructure informatique, plutôt que des interventions menées en mode pompier. Cette approche par anticipation s’étend du réseau informatique à l’ensemble des dispositifs du datacenter, surveillés en temps réel : « Les hébergeurs se concentrent sur l’aspect physique de leurs bâtiments. Ils évitent la surchauffe en sondant les climatisations. Ils vérifient les alimentations, les onduleurs du circuit de secours électrique, et même les accès physiques aux racks. Du coup, lorsqu’une armoire est ouverte en dehors de toute plage de maintenance prévue, une alerte est déclenchée », illustre-t-il. Le tour de force actuel consiste à coordonner les administrateurs autour de bonnes pratiques (confirmes Itil v3) et de logiciels d’administration capables de bien communiquer entre eux. En effet, la plateforme de supervision, souvent modulaire, est complétée par des composants logiciels chargés de capturer et de partager des indices aussi variés que la consommation électrique en KWh d’un équipement, l’état d’une liaison étendue sur un routeur ou encore des temps de réponse applicatifs de bout-en-bout, mesurés par des sondes ou des simulateurs de trafics.

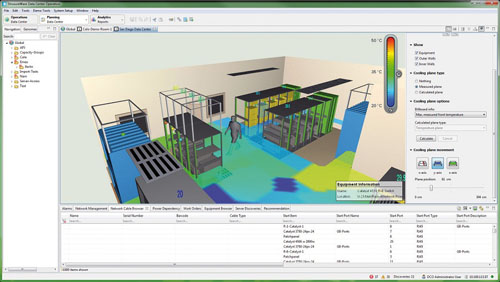

L’offre DCIM tente l’approche tout-en-un

« Les entreprises qui utilisent des outils plus intégrés, en moins grand nombre, obtiennent de meilleures performances que celles qui utilisent de nombreuses solutions ponctuelles différentes, note Shamus Mc Gillicuddy, analyste senior chez Enterprise Management Associates. Une offre intégrée fournit une visibilité de bout en bout, des fonctions de dépannage plus efficaces, une vue complète et unifiée de la santé et des performances du réseau. » Suivant cet objectif ambitieux, la plateforme DCIM (DataCenter Infrastructure Management) recueille et gère les informations des équipements du centre de données, l’usage de ses ressources et leur état de fonctionnement. C’est un système complet qui suit tous les composants des chaînes incendie, de climatisation, de sécurité et des réseaux informatiques. Son graal : optimiser les indices cruciaux du centre de données, tel que l’efficacité énergétique ou PUE (Power Usage Effectiveness). Une piste pour y parvenir consiste à réduire la production de froid nécessaire pour générer les services des clients, sans mettre en péril les serveurs.

« Une offre intégrée fournit une vue complète et unifiée de la santé et des performances du réseau. »

Shamus Mc Gillicuddy Enterprise Management Associates

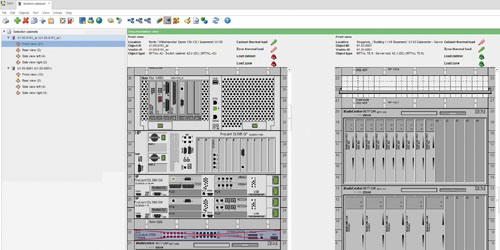

« Le ticket d’entrée d’un système DCIM (40 000 euros environ) est inaccessible aux datarooms et aux petits centres de données. Sa mise en œuvre s’avère complexe et elle impacte toute l’organisation. La bonne séquence consiste à mettre d’abord en place les processus, puis à choisir les outils ensuite », recommande Philippe Bernardini, consultant de PB Informatique. Dans un premier temps, l’équipe de production pourra se concentrer sur la gestion des salles avant de se pencher sur la répartition des points chauds puis sur l’urbanisation du site complet. Les solutions DCIM réduisent les temps de résolution des pannes et des incidents. Elles contribuent à gérer les capacités, évitant de sur-dimensionner les équipements acquis. A eux seuls, ces deux apports génèrent un retour sur investissement rapide. Néanmoins, on distingue toujours deux populations d’intervenants dans le centre de données : les premiers se concentrent sur les moyens techniques du bâtiment tandis que les seconds se focalisent sur l’administration des ressources IT. Cette dichotomie pose une problématique d’exploitation globale, soulève François Boltz, président de Silakan : « L’exploitant doit délivrer une qualité de services continue aux clients. C’est la raison pour laquelle la partie DCIM est détachée des services généraux et rattachée progressivement à l’informatique ». C’est un glissement similaire à celui que l’on note pour la téléphonie, les contrôles d’accès, les capteurs et objets connectés, désormais conformes aux protocoles IP. « A la frontière entre le suivi des actifs informatiques (ITSM) et la gestion technique du bâtiment (DCIM), on trouve l’équipement informatique. Les deux plateformes fonctionnent autour de bases de données, mais elles ne stockent pas les mêmes informations. Il faut donc créer des ponts entre elles », conseille-t-il.

Gérer l’intégralité du rack

Bâtir un référentiel commun pour repérer tous les actifs du datacenter fait du sens. Cela permet de rentabiliser, voire de mutualiser des investissements d’infrastructure.

Iconics

« Il subsiste aujourd’hui une vraie discordance entre le suivi technique du bâtiment et la gestion du cœur des racks informatiques. On essaie de relier ces deux mondes et cela commence par une base commune pour faire transiter les données d’un système à l’autre et offrir une meilleure efficacité globale », confirme Bastien Fleuret, ingénieur commercial d’Iconics.

Un tableau de bord pour chaque intervenant

Les directions générales, techniques et informatiques n’ont pas besoin des mêmes tableaux de bord que les administrateurs, signale pour sa part Christophe Da Fonseca. « Un retour synthétique, non détaillé, convient souvent aux managers. Il faut offrir un rendu visuel au niveau de celui qui va l’utiliser. Si trois des quatre liens étendus fonctionnent, les flux entrants et sortants fonctionnent toujours, les services tournent, certes en mode dégradé. C’est un feu vert pour la direction mais un feu orange ou rouge pour l’opérationnel qui doit intervenir sur la passerelle défectueuse ». Il observe que de nombreuses entreprises font encore manuellement des opérations qui pourraient s’automatiser autour de modèles de supervision, par types de sites ou familles de serveurs, avec des paliers de notification adaptés. « Une surveillance fine des temps de réponse cloud permet de renégocier les accords SLA avec les prestataires de services externes, autour d’éléments factuels comme le taux de disponibilité mesuré, site par site, sur l’année écoulée. Pendant la tempête, le ressenti n’est jamais le factuel », ajoute-t-il.

En consignant leurs interventions de maintenance, au fil du temps, les exploitants enrichissent une base de connaissances stratégique. Elle permet de régler les soucis les plus fréquents sur les accès distants, les serveurs de traitements ou de données, de vérifier d’où provient une coupure Internet ou comment réparer une dégradation de temps de réponse vers une base de données très sollicitée. En cas d’alerte ou de dépassement d’un seuil, une liaison avec les incidents comparables dans le passé devient visible, qui facilite leur résolution en un temps record.

Un œil sur le datacenter de chaque prestataire

A l’échelle d’un datacenter, il est complexe de prédire l’activité des équipements. Comment savoir quels types de ressources seront nécessaires dans quinze minutes ou dans deux heures ? « Des logiciels d’apprentissage (Machine Learning) complètent l’IT management pour s’adapter à la demande croissante et au besoin de comprendre le profil de performances d’un ensemble de systèmes », explique Vincent Franceschini, Chief Research Officer d’Hitachi Data Systems. Reste à étudier l’impact des conteneurs et celui des divers types d’applications, pour bâtir des architectures modulaires capables d’assembler des éléments de façon évolutive. Cela permettra aux équipements de réseaux ou de stockage pilotés par logiciels de s’adapter dynamiquement, en fonction des niveaux de performances et de résilience nécessaires à chaque activité de l’entreprise.

Datacenter : optimiser les performances

« Un réseau efficace doit être en mesure de livrer une bonne qualité de services et d’offrir aussi une expérience client de qualité », souligne Bernard Breton, vice-président de l’éditeur français InfoVista.

InfoVista

Il constate une recherche croissante d’efficacité opérationnelle et financière, en particulier dans les réseaux d’opérateurs et de CSP. « Orange Business Services offre une visibilité applicative à ses clients au travers de nos technologies. Notre solution Vista Insight for Network est déployée chez 80% des opérateurs de premier rang. Elle facilite la migration vers la virtualisation, qui n’est pas aussi simple en pratique que sur le papier », constate-t-il. A mesure que les opérateurs déploient des réseaux SDN/NFV, SD-WAN ou se préparent à la 5G, le suivi des performances applicatives va conditionner leur efficacité opérationnelle et apporter des services différenciés. « C’est essentiel pour maximiser les revenus, combattre l’évasion des clients et maintenir la production au meilleur niveau, tout en étant efficace dans la gestion de l’infrastructure », conclut-il.